IA : quels risques pour les TPE/PME et comment les éviter ?

L’intelligence artificielle se glisse partout. Discrète mais puissante, elle s’invite dans les mails, s’immisce dans les outils de travail, et colonise les habitudes. Les PME en font un levier de performance, sans toujours en mesurer les contreparties. Derrière les promesses d’automatisation et d’efficacité, certains usages exposent vos données, vos idées, vos clients. Cet article vous aide à y voir clair — sans détour ni panique — pour adopter l’IA avec discernement.

Ce qu’on ne dit jamais : les contreparties invisibles de l’IA

L’IA se présente comme un assistant. Polyvalent. Infatigable. Disponible à toute heure. Derrière cette image flatteuse, les conditions d’utilisation imposées par les éditeurs de services d’IA racontent une toute autre histoire.

Une histoire où chaque prompt, chaque document, chaque code confié peut être absorbé, traité, puis réutilisé — parfois à votre insu.

Ce que vous tapez dans l’IA ne vous appartient plus

Lorsque vous utilisez un outil comme ChatGPT, Gemini, Claude ou Copilot, chaque requête alimente un moteur. En apparence, vous obtenez un résultat. En réalité, vous venez aussi de céder quelque chose.

Les conditions générales d’utilisation (CGU) de nombreux fournisseurs stipulent que les contenus générés peuvent être réutilisés à des fins de test, d’amélioration ou d’entraînement. Autrement dit : les productions issues de vos propres idées peuvent devenir du matériau exploitable par des tiers.

Extrait des CGU d’OpenAI :

Cela pose deux problèmes majeurs :

- La propriété intellectuelle s’effrite : vous exploitez une IA pour produire un contenu, mais le contenu ne vous revient pas intégralement.

- Le secret industriel s’évapore : ce que vous croyez confidentiel devient, de facto, disponible pour analyse algorithmique.

Dans certains secteurs — juridique, financier, industriel —, cette fuite d’originalité ou d’innovation compromet directement la valeur de l’entreprise.

Ce que vous donnez à l’IA peut être capté, analysé, revendu

On oublie trop souvent que ce que l’on saisit dans une interface IA ne disparaît pas dans le néant.

Ces données entrent dans un pipeline d’analyse. Elles peuvent :

- être stockées temporairement ou durablement,

- servir à affiner les modèles,

- ou, dans certains cas, être partagées avec des partenaires.

Un cas tristement célèbre illustre ce point. Chez Samsung, un ingénieur a notamment copié-collé un extrait de code confidentiel dans une IA publique pour obtenir de l’aide. Ce code, absorbé par l’algorithme, a alors potentiellement été intégré dans les futures réponses du modèle.

Résultat : fuite potentielle d’un actif stratégique.

IA gratuite vs IA payante : attention aux fausses économies

Une IA gratuite, c’est tentant. Rapide. Simple. Efficace. Mais c’est rarement un cadeau.

Le modèle économique repose sur une équation claire : si vous ne payez pas avec de l’argent, vous payez avec vos données.

La version gratuite d’un outil sert à collecter un maximum de contenu pour nourrir les modèles.

Prenons l’exemple de Microsoft Copilot :

- Version standard (incluse) : collecte et indexe les données de votre machine pour alimenter ses fonctions prédictives.

- Version entreprise premium : cloisonnement renforcé, promesse contractuelle de non-exploitation des données.

Une IA sérieuse pour un usage professionnel mérite un cadre contractuel sérieux. Et cela a un coût. Le bon choix dépend donc davantage de votre sensibilité aux risques que de votre budget.

Collecte de données à grande échelle sur vos devices

Le piège ne se limite pas aux interfaces web. Les fournisseurs injectent désormais l’IA directement dans les logiciels et systèmes d’exploitation.

Un exemple frappant : l’arrivée de Copilot dans Notepad, l’éditeur de texte basique de Windows. À première vue, un simple ajout de confort. En réalité, une porte d’entrée vers une nouvelle couche de captation de contenu.

Dès lors :

- chaque texte saisi devient une donnée exploitable,

- chaque fichier temporaire peut être indexé,

- chaque mot tapé — même non enregistré — rejoint un écosystème de collecte automatisée.

Cette collecte s’effectue souvent sans visibilité claire sur les flux de données, ni contrôle réel de l’utilisateur final. Croisée avec le cloud, la télémétrie et les services tiers, cette mécanique fait émerger une problématique sérieuse de confidentialité hybride : vos données locales ne le sont plus vraiment.

Conséquences pour les PME : du flou juridique au vrai risque business

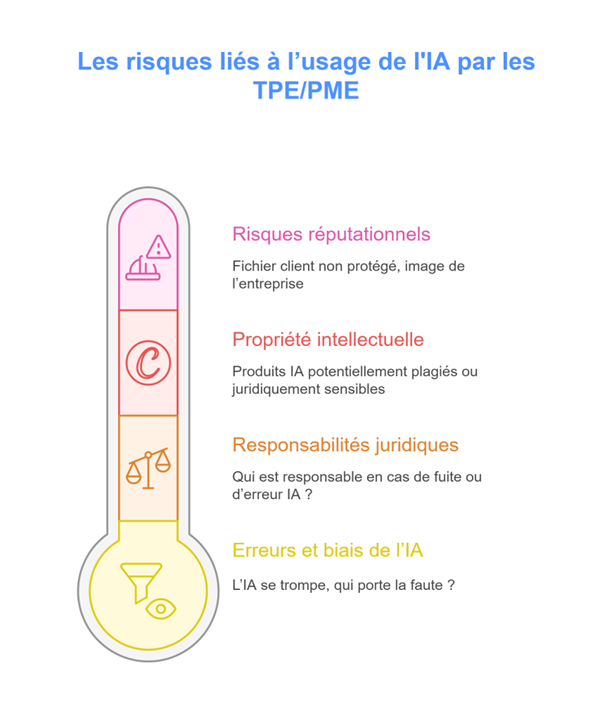

Responsabilités juridiques

Imaginez : un employé utilise ChatGPT pour rédiger une réponse à un appel d’offre. Le prompt contient des éléments stratégiques.

L’IA récupère, traite, propose un texte… que l’entreprise envoie sans modification. Une fuite de données en résulte. À qui incombe la faute ?

Le flou s’installe :

- L’employé a-t-il mal évalué le périmètre de confidentialité ?

- L’entreprise a-t-elle formé ses équipes aux usages sûrs ?

- Le fournisseur IA est-il couvert par des clauses qui le dédouanent de tout ?

En l’absence de processus clairs et de chartes internes, la responsabilité retombe quasi systématiquement sur l’entreprise utilisatrice. Y compris si celle-ci ignorait les conditions exactes du service.

Propriété intellectuelle et droits d’auteur

Ce que produit une IA ne sort pas de nulle part. Ses réponses s’appuient sur des bases d’apprentissage. Certaines sont libres. D’autres sont ambiguës. D’autres encore enfreignent potentiellement le droit d’auteur.

Prenons le cas d’une IA générative d’images. Vous demandez : « un visuel de style Pixar pour illustrer mon site web ». Résultat : une création originale… en apparence. En réalité, elle contient peut-être des fragments esthétiques empruntés à des œuvres existantes, protégées.

Cela pose un triple problème :

- Vous utilisez un contenu juridiquement incertain dans une démarche commerciale.

- Vous exposez votre entreprise à des plaintes pour contrefaçon, même involontaires.

- Vous dévalorisez votre image en vous appuyant sur une création douteuse.

Et si vous êtes prestataire, ce risque devient aussi celui de vos clients. Un contentieux en cascade.

Erreurs et biais de l’IA

Par ailleurs, une IA peut se tromper. Elle le fait souvent. Et surtout, elle le fait avec aplomb.

Si vous reprenez telle quelle une analyse, une donnée, une recommandation produite par un assistant IA, vous engagez votre nom, votre entreprise, votre crédibilité.

Les risques :

- Chiffres erronés repris dans une présentation stratégique.

- Traduction faussée dans un contrat international.

- Information biaisée intégrée à une politique RH ou commerciale.

Dans tous ces cas, l’outil IA ne peut pas être tenu responsable. C’est vous, en tant qu’utilisateur, qui avez validé, transmis ou publié une donnée non vérifiée.

La jurisprudence est encore jeune, mais la logique est implacable : l’humain reste comptable de l’usage qu’il fait de la machine.

Risques réputationnels

Imaginez un scénario courant : un collaborateur prépare une présentation. Il y insère, sans y penser, des informations internes non anonymisées — coordonnées client, données sensibles, tableaux financiers…

L’outil bureautique utilisé intègre une fonction IA. Celle-ci indexe ces contenus pour enrichir ses capacités de suggestion ou d’assistance.

Plus tard, une commande vocale, une fonction de résumé automatique ou une recherche rapide ressuscite ces données, parfois hors de leur contexte initial. Une personne non autorisée y accède. La brèche est ouverte.

Ce type d’incident ne relève pas du piratage. Il résulte d’un usage sans garde-fou. Et il suffit à entamer durablement la réputation d’une entreprise. Dans les secteurs sensibles, cela peut même provoquer une perte de confiance difficile à réparer.

Que faire ? Deux axes simples et accessibles pour une IA sécurisée

1 – Sensibiliser et former les équipes internes

Aucune technologie, aussi performante soit-elle, ne compense un manque de culture numérique. Ce n’est pas une question de compétence, mais de conscience.

Chaque collaborateur manipule des données. Certains utilisent l’IA à titre personnel, d’autres pour accélérer des tâches professionnelles.

Par défaut, ces usages se développent sans cadre. C’est précisément ce qu’il faut changer.

Créer une charte IA

La première étape consiste à formaliser une charte claire, lisible, opérationnelle. Elle fixe un cadre :

- quels outils sont autorisés,

- dans quelles conditions,

- avec quelles limites.

Ce document n’a pas vocation à freiner l’innovation, mais à en garantir la cohérence. Il protège les collaborateurs autant que l’organisation.

Cas pratiques à intégrer

Pour ancrer les bons réflexes, rien ne vaut la clarté des exemples concrets.

Incluez dans votre charte des cas précis :

- Ne jamais copier de données client dans une interface IA publique.

- Utiliser uniquement des IA validées par le service IT.

- Préférer le mode hors ligne dès que possible.

- Activer le chiffrement des documents générés.

Ces règles simples réduisent significativement les risques de fuite ou d’abus. Elles créent une culture de vigilance, sans générer de stress inutile.

2 – Choisir des outils compatibles avec votre niveau de sécurité

Vous n’êtes pas obligé de renoncer à l’IA. Bien au contraire. Encore faut-il sélectionner les bons outils.

Deux approches se démarquent :

- Les IA Open Source auto-hébergées : elles offrent un excellent contrôle sur les flux de données. Vous gardez la main sur l’infrastructure, définissez vos règles de sécurité, et éliminez les dépendances externes.

- Les IA premium avec cloisonnement contractuel : conçues pour les environnements professionnels, elles garantissent un traitement des données plus respectueux et plus sécurisé. Elles ne sont pas gratuites, mais leur coût se justifie généralement par le niveau de protection proposé.

Lire (vraiment) les contrats

Les CGU ne sont pas de la littérature. Ce sont des clauses d’engagement. Elles régissent vos droits, vos limites, vos risques.

Trop souvent, ces documents sont acceptés sans lecture, sans filtre, sans compréhension.

Voici quelques pièges classiques à repérer :

- clauses floues sur la réutilisation des contenus,

- absence de garantie de confidentialité,

- transferts de données vers des juridictions non couvertes par le RGPD,

- désengagement contractuel du fournisseur en cas de fuite.

Conclusion : l’IA, oui, mais pas n’importe comment !

Les outils d’intelligence artificielle transforment la façon dont les entreprises produisent, collaborent, et innovent. Ils ouvrent des perspectives enthousiasmantes.

Mais mal encadrés, ils peuvent aussi ouvrir la porte à des fuites, des contentieux, des pertes de valeur.

En adoptant une approche raisonnée — centrée sur la formation des équipes et le choix rigoureux des outils —, vous regagnez le contrôle.